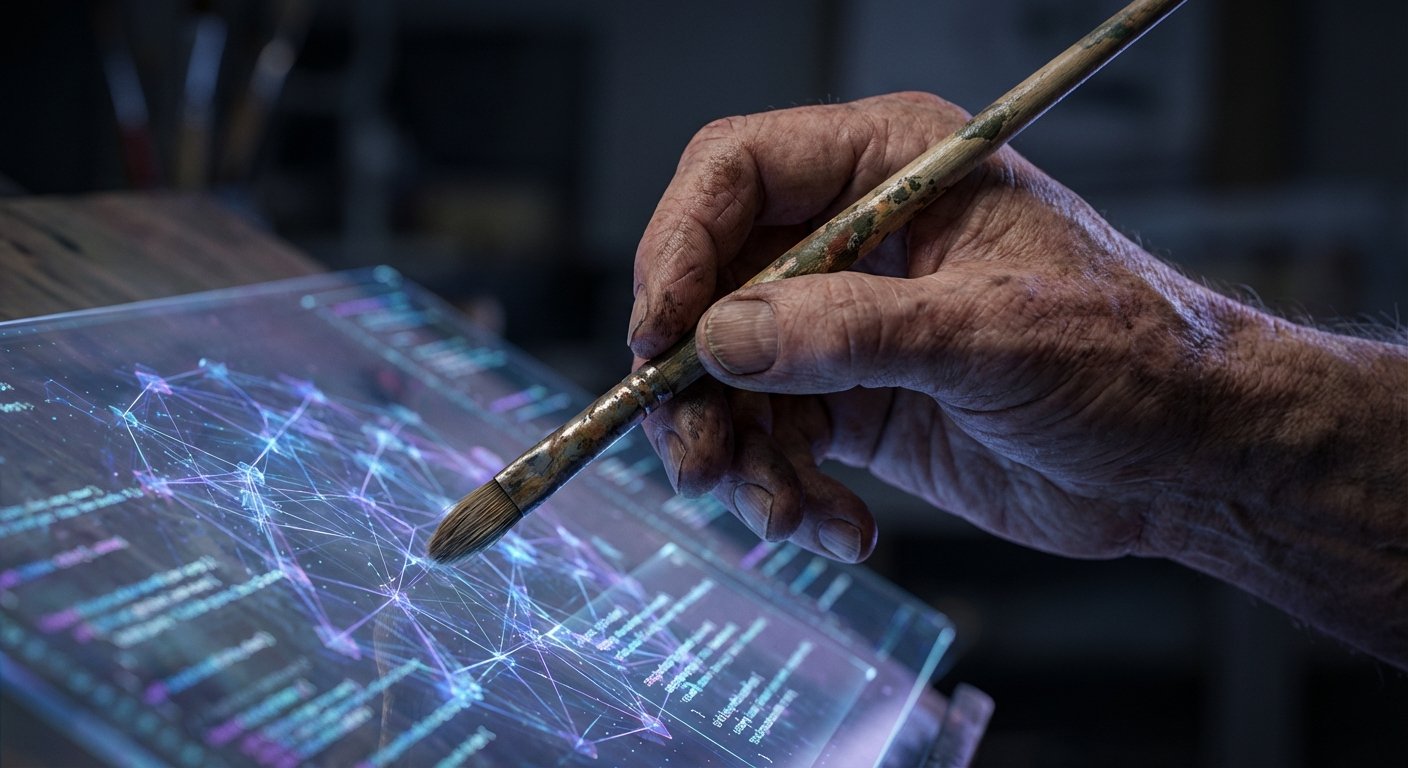

El mito del robot artista: Cómo «piensa» realmente una red neuronal

Para entender este jaleo, lo primero es bajar a la IA del pedestal místico. A menudo escucho que Midjourney o DALL-E «se inspiran» como lo haría un estudiante en el Prado, pero ojo con esto: una red neuronal no tiene ojos, ni alma, ni resaca. Lo que tiene es una potencia de cálculo brutal para desmenuzar imágenes en vectores matemáticos. Al lío: la IA no copia y pega píxeles; lo que hace es identificar patrones estadísticos. Sabe que, estadísticamente, un «atardecer de Van Gogh» implica ciertas frecuencias de color y formas espirales.

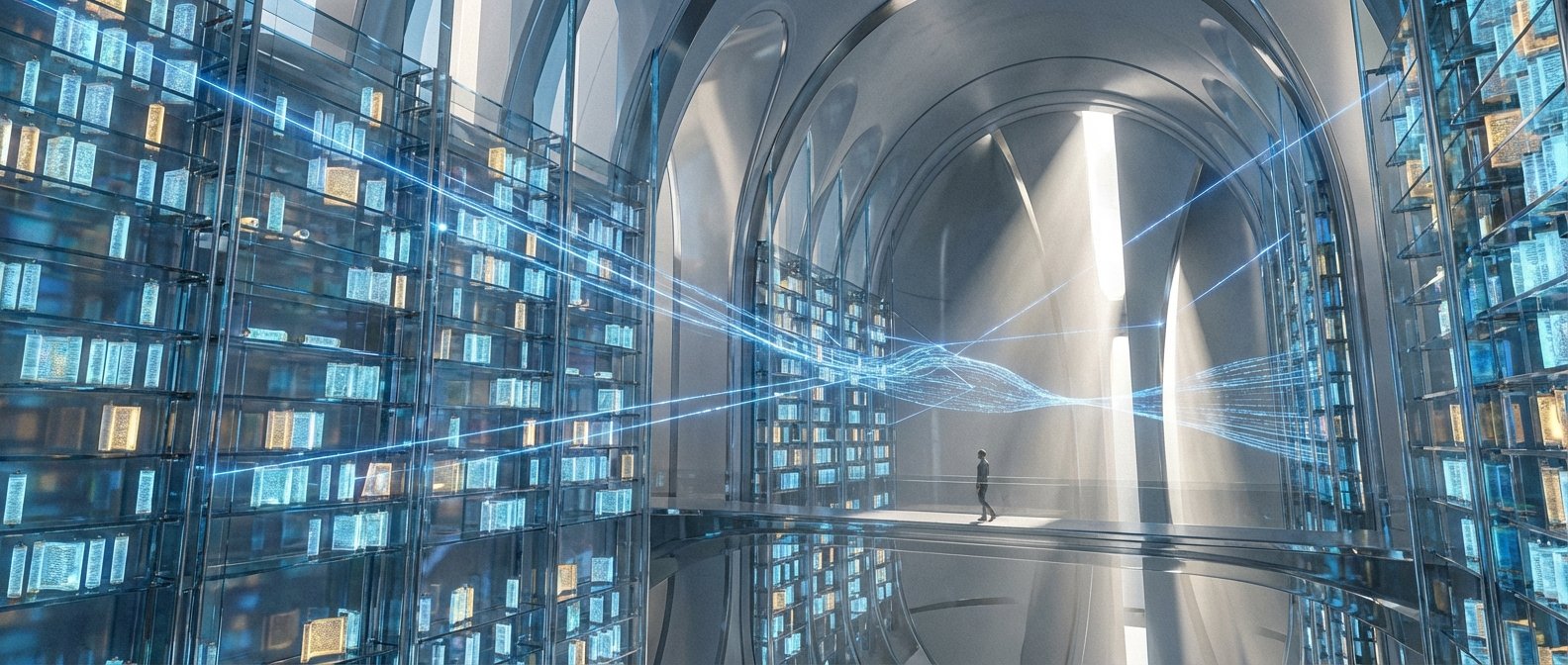

El problema técnico (y ético) reside en la materia prima. Para que estos modelos sean coherentes, necesitan «comer» miles de millones de imágenes. No valen un par de cientos de fotos de archivo; hablamos del scraping masivo de todo lo que hay en la web abierta. El entrenamiento se convierte en un proceso de destilación donde la esencia del trabajo de millones de artistas se convierte en el «peso» de un algoritmo, a menudo sin que esos artistas supieran siquiera que estaban alimentando a la máquina.

Scraping masivo: ¿Inspiración legítima o plagio a escala industrial?

Aquí es donde la cosa se pone tensa. Los defensores de la IA suelen argumentar el «Fair Use» (uso legítimo), comparando el entrenamiento de la máquina con un artista humano que aprende viendo cuadros ajenos. Pero hay una diferencia técnica insalvable: la escala. Mientras un humano tarda décadas en procesar influencias para crear un estilo propio, la IA puede fagocitar el portfolio completo de un ilustrador en segundos y replicar su «estética» de forma infinita. No es sensibilidad, es procesamiento de volumen.

A menudo vemos en las imágenes generadas esas marcas de agua emborronadas que parecen firmas. Es el rastro del crimen: la prueba de que el modelo ha memorizado tanto una fuente original que intenta replicar hasta la rúbrica del autor, convirtiendo la inspiración en una suerte de plagio industrial automatizado.

La jerarquía del consentimiento: Del portfolio al modelo matemático

En el mundo tech, hemos pasado del «pide perdón antes que permiso» a una situación de vulnerabilidad total para los creadores. Actualmente, el debate se centra en los modelos Opt-out frente a los Opt-in. La mayoría de las grandes tecnológicas asumen que tus datos (tu arte) les pertenecen para entrenar sus modelos a menos que tú, proactivamente, les pidas que no lo hagan. Es como si alguien te roba la gasolina del coche y te dice que, si no te gusta, pongas un candado la próxima vez.

Esta jerarquía pone al artista en la base de la pirámide, sirviendo como «gasolina gratuita» para productos que luego se venden mediante suscripción. La extracción de valor es clara: el creador aporta la materia prima (el estilo, la técnica) y la tecnológica se queda con el beneficio del output final optimizado.

Resistencia digital: Envenenando el pozo con Glaze y Nightshade

Pero no todo está perdido, y aquí es donde mi lado más «geek» se emociona. Como respuesta a este scraping descontrolado, han surgido herramientas de resistencia técnica como Glaze y Nightshade, desarrolladas por investigadores de la Universidad de Chicago. ¿Cómo funcionan? Básicamente, aplican cambios microscópicos a los píxeles de una imagen que son invisibles al ojo humano, pero que confunden por completo a la IA.

«Si una IA intenta aprender de una imagen ‘envenenada’ con Nightshade, creerá que un gato es un perro o que un estilo hiperrealista es cubismo.»

Es una guerra de guerrillas digital. Al mismo tiempo, gigantes como Adobe están intentando lavar su imagen con Firefly, un modelo entrenado únicamente con imágenes de Adobe Stock (por las que ya tienen derechos) y contenido de dominio público. Es un intento de crear un ecosistema donde haya una compensación real, aunque muchos artistas siguen siendo escépticos sobre si las migajas que reciben por el entrenamiento compensan la pérdida de mercado futuro.

Conclusión: El artista como piloto en la era de la canibalización

Llegamos al punto clave: ¿va la IA a sustituir al artista? En SavageFlow creemos que no, pero sí que va a canibalizar el trabajo de «commodity». La IA es un copiloto técnico increíble, capaz de ahorrar horas de renderizado o búsqueda de referencias, pero el criterio, la intención narrativa y la experiencia vital siguen siendo exclusivos de nuestra especie (por ahora).

El futuro pasa necesariamente por una legislación que no solo proteja el copyright, sino el cimiento creativo. Necesitamos leyes que reconozcan que el «estilo» tiene un valor y que el entrenamiento de modelos comerciales no puede ser un buffet libre. El pincel ha cambiado de forma, pero la mano que decide hacia dónde va el trazo debe seguir siendo la nuestra.